Den digitala världen utvecklas ständigt, och en katalysator som skiljer denna plattform från de andra är användargenererat innehåll. Även om företag över hela världen har sina webbplatser och dedikerade närvaro på sociala medier, är det mer sannolikt att användare litar på sina medkunders åsikter än att de går efter företagets ord.

Mer än 4.26 miljarder människor var aktiva användare av sociala medier 2021. Ett antal förutspåddes att nå 6 miljarder-strecket år 2027. Mängden innehåll som genererades, fångas, delas och konsumeras på global skala nådde 64.2 zettabyte 2020.

Med nytt innehåll som genereras och konsumeras i en svindlande takt, har det blivit viktigt att varumärken håller koll på innehållet som finns på deras plattformar. Online plattformar bör vara och förbli en säker miljö för sina användare.

[Läs även: Förstå automatiserad innehållsmoderering]

Vad är innehållsmoderering och varför?

Användargenererat innehåll driver sociala medieplattformar, och innehållsmått hänvisar till att screena detta innehåll för olämpliga eller stötande inlägg. Affärs- och sociala medieplattformar har en specifik standard för att övervaka deras värdinnehåll.

Riktlinjerna kan omfatta allt från våld, extremism, hatpropaganda, nakenhet, upphovsrättsintrång eller något stötande. Det upplagda innehållet kommer att flaggas och tas bort om det inte uppfyller standarden.

Tanken bakom innehållsmoderering är att säkerställa att innehållet är i linje med varumärkets ideal och upprätthåller värdena anständighet, förtroende och säkerhet.

Moderering av innehåll är avgörande för att företag ska kunna upprätthålla affärsstandarder, varumärkesimage, rykte och trovärdighet. Varje sekund gör den svindlande mängden användargenererat innehåll som publiceras på plattformar det utmanande för varumärken att hålla sig utanför offensiv och opassande innehåll, text, videor och bilder. Strategin för innehållsmoderering hjälper varumärken att behålla sin image samtidigt som de tillåter användare att uttrycka sig och stänger av stötande, explicit och våldsamt innehåll.

Vilka innehållstyper kan du moderera?

Algoritmer för innehållsmoderering hanterar vanligtvis tre eller en kombination av dessa innehållstyper.

text

Den stora mängden text – från kommentarer till fullängdsartiklar – som behöver modereras är ganska häpnadsväckande. Textinlägg är tillgängliga nästan var som helst i form av kommentarer, artiklar, foruminlägg, diskussioner i sociala medier och andra inlägg.

Algoritmer för moderering av textinnehåll bör kunna skanna text av olika längder och stilar efter oönskat innehåll. Dessutom kan textmoderering vara en svår uppgift på grund av språkets komplexitet och kulturella nyanser.

Bilder

Bildmoderering är mycket enklare än textmoderering, men det är viktigt att ha ordentliga riktlinjer eller standarder på plats.

Dessutom, eftersom kulturella skillnader kan spela in vid moderering av bilder, är det avgörande att grundligt förstå och få kontakt med användargemenskapen på flera geografiska platser.

Video

Moderering av videoinnehåll är mycket svårt, eftersom moderering av videor kan vara tidskrävande, till skillnad från text eller bilder. Moderatorn måste se hela videon innan den bedömer att den är lämplig eller olämplig för konsumtion. Även om bara ett fåtal bildrutor i videon är explicita eller störande, kommer det att tvinga moderatorn att ta bort hela innehållet.

Live streaming

Livestreaming är kanske det mest utmanande innehållet att moderera. Det beror på att video och tillhörande textmoderering måste ske samtidigt med strömningen.

Hur fungerar innehållsmoderering?

För att komma igång med att moderera innehållet på din plattform bör du först införa standarder eller riktlinjer som avgör olämpligt innehåll. Dessa riktlinjer hjälper moderatorer att flagga innehåll för borttagning.

Definiera känslighetsnivån eller tröskeln innehåll moderatorer bör överväga när de granskar innehåll. Tröskeln bör definieras utifrån ditt varumärke, typen av verksamhet, användarnas förväntningar och plats.

Typer av innehållsmoderering

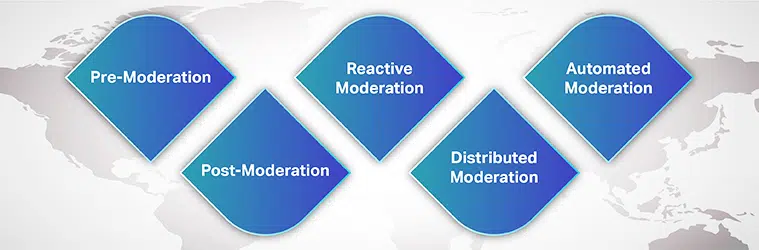

Du kan välja mellan många modereringsprocesser för ditt varumärkes behov och användarens samtycke. Några av dem är:

Förmoderering

Innan innehållet visas på din sida står det i kö för moderering. Först efter att innehållet har granskats och bedömts lämpligt för konsumtion publiceras det på plattformen. Även om detta är en säker metod för att blockera explicit innehåll, är det tidskrävande.

Efter moderering

Postmoderering är standardmetoden för innehållsmoderering där det finns en avvägning mellan användarengagemang och moderering. Även om användare tillåts lägga upp sina bidrag, står det fortfarande i kö för moderering. Om innehållet har flaggats granskas och tas det bort. Företag strävar efter att få en kortare granskningstid så att olämpligt innehåll inte tillåts vara online för länge.

Reaktiv moderering

I reaktiv moderering uppmuntras användargemenskapen att flagga olämpligt innehåll som bryter mot gemenskapen regler och riktlinjer. I denna metod dras gemenskapens uppmärksamhet till innehållet som behöver modereras. Det stötande innehållet kan dock stanna kvar på plattformen under längre perioder.

Distribuerad moderering

I en distribuerad modereringsmetod kan onlinegemenskapen granska, flagga och ta bort innehåll som de finner stötande och mot riktlinjer med hjälp av ett klassificeringssystem.

Automatiserad moderering

Som namnet antyder använder automatisk moderering olika verktyg och system för att flagga ord eller fraser och avvisa bidrag. Det fungerar genom att filtrera bort vissa förbjudna ord, bilder och videor med hjälp av maskininlärningsalgoritmer.

Även om teknikdriven moderering blir vanligare, mänsklig måttlighet i granskning kan inte bortses från. Företag använder helst en kombination av automatiserade verktyg och mänskliga moderatorer, åtminstone för komplexa situationer.

[Läs även: Fallstudie – Moderering av innehåll]

Hur hjälper Machine Learning innehållsmoderering?

Med mer än 5 miljarder människor som använder internet och över 4 miljarder aktiva på sociala medienätverk är det inte lätt att bli förvånad över det stora antalet bilder, texter, videor, inlägg och meddelanden som genereras dagligen. Detta mastodontinnehåll måste modereras på något sätt så att användare som kommer åt deras sociala medier kan få en trevlig och berikande upplevelse.

Innehållsmoderering kom till som lösningen för att ta bort innehåll som är explicit, stötande, kränkande, bedrägeri eller mot varumärkets etos. Traditionellt har företag helt förlitat sig på mänskliga moderatorer för att granska onlineanvändargenererat innehåll som publiceras på deras plattformar. Men helt beroende av mänskliga moderatorer kan processen göra processen tidskrävande, kostsam och ineffektiv.

Företag använder nu maskininlärningsalgoritmer för att automatiskt och effektivt moderera innehåll. AI-powered innehållsmoderering har gjort hela processen effektiv, snabbare, konsekvent och kostnadseffektiv.

Även om denna process inte eliminerar behovet av mänskliga moderatorer – människa-i-slingan, bidraget från mänskliga moderatorer hjälper till att hantera komplexa frågor. Dessutom förstår mänskliga moderatorer språknyanser, kulturella skillnader och sammanhang bättre. När automatiserade verktyg används, med hjälp av mänskliga moderatorer, minskar det den psykologiska effekten av exponering för utlösande innehåll.

Utmaningar med moderering av innehåll

En annan stor utmaning när det gäller att utveckla en korrekt innehållsmodereringsalgoritm är språket. En pålitlig applikation för innehållsmoderering bör kunna känna igen flera språk och förstå kulturella nyanser, sociala sammanhang och språklig dynamik.

Eftersom ett språk går igenom flera förändringar över tid, eftersom vissa ord som var oskyldiga i går kunde ha gjort sig känd idag – måste ML-modellen hålla jämna steg med den föränderliga världen. Till exempel kan en nakenmålning vara explicit och voyeuristisk eller helt enkelt konst.

Hur a innehåll upplevs eller anses olämpligt beror på sammanhanget. Och det är avgörande att ha konsekvens och standarder inom din plattform så att dina användare kan lita på dina modereringsinsatser.

En typisk användare försöker alltid hitta kryphål i dina riktlinjer och kringgå modereringsregler. Din ML-algoritm bör dock kunna utvecklas med de föränderliga tiderna kontinuerligt.

Slutligen är det frågan om partiskhet. Att diversifiera din träningsdatabas och träningsmodeller för att upptäcka sammanhang är avgörande. Även om det kan verka utmanande att utveckla en tillförlitlig algoritm för innehållsmoderering, börjar det med att lägga vantarna på högkvalitativa träningsdatauppsättningar.

Tredjepartsleverantörer med rätt expertis och erfarenhet av att leverera adekvata utbildningsdatauppsättningar är rätt ställen att börja.

Varje företag med social närvaro behöver en spets lösning för innehållsmoderering som hjälper till att bygga upp kundernas förtroende och en oklanderlig kundupplevelse. För att bygga applikationen och träna din maskininlärningsmodell behöver du tillgång till en högkvalitativ databas utan fördomar, anpassad till de senaste språkvetenskapliga och marknadsspecifika innehållstrenderna.

Med vår mångåriga erfarenhet av att hjälpa företag att lansera AI-modeller, Shaip erbjuder omfattande datainsamlingssystem som tillgodoser olika behov av innehållsmoderering.